No primeiro dia de um conflito de proporções significativas entre os Estados Unidos e o Irã, um ataque devastador atingiu a Escola Primária Shajareh Tayyebeh, localizada na cidade de Minab, no sul do Irã. A ofensiva, realizada por um míssil de cruzeiro Tomahawk, resultou na morte de, no mínimo, 168 pessoas. Entre as vítimas, mais de uma centena eram crianças com menos de 12 anos de idade, conforme dados alarmantes divulgados por autoridades da Organização das Nações Unidas (ONU) e do próprio governo iraniano. Este incidente trágico não apenas marcou o início das hostilidades, mas também lançou uma sombra de questionamentos profundos sobre os métodos e a precisão da inteligência utilizada em operações militares de alta complexidade, especialmente aquelas que envolvem sistemas de mira avançados e o uso de inteligência artificial (IA).

O contexto do ataque e as primeiras investigações

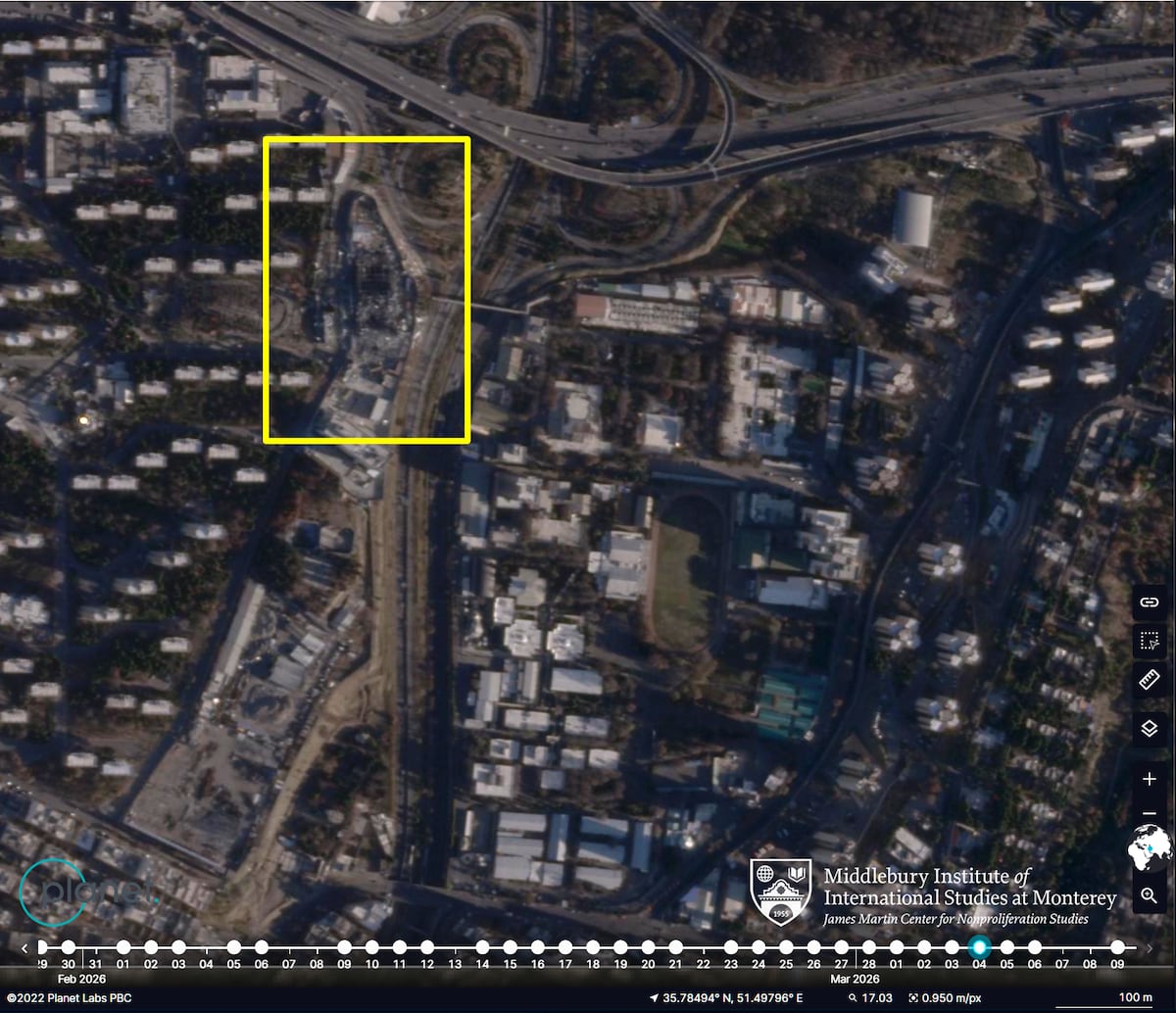

A localização da Escola Shajareh Tayyebeh tem sido um ponto central nas investigações. A estrutura educacional situava-se a menos de 90 metros de uma instalação naval da Guarda Revolucionária Islâmica (IRGC), que operava há muito tempo na região. Análises de imagens de satélite conduzidas pela Anistia Internacional revelaram que, entre 2013 e 2016, a escola, que antes estava dentro do perímetro do complexo da IRGC, foi separada por um muro. No momento em que os Estados Unidos e Israel lançaram seus primeiros ataques em 28 de fevereiro, a escola já estava em pleno funcionamento há vários anos. Uma investigação da agência de notícias Reuters confirmou que a instituição possuía presença ativa nas mídias sociais e mantinha seu próprio website, indicando sua visibilidade e operação pública.

Diante da magnitude da tragédia e da proximidade com um alvo militar sensível, a pergunta central que surgiu foi: o que exatamente deu errado? Em 12 de março, apenas alguns dias após 46 senadores democratas terem feito um pedido similar, mais de 120 deputados democratas da Câmara dos Representantes dos EUA enviaram uma carta ao Pentágono, exigindo esclarecimentos. O questionamento principal era: “Foi a inteligência artificial, incluindo o uso do sistema inteligente Maven, utilizada para identificar a escola Shajareh Tayyebeh como um alvo?”

O sistema maven e a complexidade da inteligência artificial no campo de batalha

O sistema inteligente Maven, uma plataforma de direcionamento e inteligência desenvolvida pela empresa de análise de dados Palantir Technologies sob um contrato de 1,3 bilhão de dólares com o Pentágono, foi concebido para lidar com um desafio crescente: a sobrecarga de informações. Utilizando a inteligência artificial como seu principal recurso, o Maven integra diversas fontes de dados, como imagens de satélite, transmissões de drones, dados de radar e informações de inteligência de sinais, em uma única interface. Sua função é classificar alvos, recomendar sistemas de armas apropriados e gerar pacotes de ataque em tempo quase real, agilizando drasticamente os processos de raciocínio da “kill chain” e a tomada de decisões no campo de batalha. O sistema ainda incorpora o modelo de IA Claude da Anthropic, que opera semi-autonomamente para classificar alvos por importância estratégica e elaborar justificativas legais automáticas para cada ataque. Segundo o jornal The Washington Post, o software gerou centenas de coordenadas de ataque nas primeiras 24 horas da campanha contra o Irã, permitindo que os EUA atingissem mais de mil alvos no primeiro dia do conflito.

Após fontes informadas sobre as descobertas preliminares terem revelado à CNN que o Comando Central dos EUA havia criado coordenadas de direcionamento utilizando inteligência desatualizada, fornecida pela Agência de Inteligência de Defesa (DIA), que não havia sido atualizada para refletir a presença da escola, a questão central das investigações se tornou ainda mais premente: “Se sim, um ser humano verificou a precisão deste alvo?” As autoridades ainda aguardam uma explicação oficial para o ocorrido.

A responsabilidade humana e os limites da IA em cenários de combate

Operadores de drones ucranianos, que desenvolvem e implementam sistemas de direcionamento semi-autônomos na linha de frente, imediatamente reconheceram o provável cenário do incidente. Ihor Matviyuk, diretor da Aero Center, uma empresa ucraniana de drones engajada na guerra contra a Rússia, declarou à Military Times que, embora não tivesse conhecimento interno específico do ataque em Minab, o evento carregava as marcas de uma falha de direcionamento, e não de um mau funcionamento da IA. “Foi quase definitivamente um ataque nas coordenadas [fornecidas]”, afirmou Matviyuk. “O principal problema não foi a IA – foi a proximidade do objeto militar com a escola.” Na semana anterior, ex-oficiais militares, em declaração ao Semafor, corroboraram a avaliação inicial de Matviyuk: “Humanos – e não a IA – são os culpados” pelo ataque à escola, apontando para dados desatualizados e curados por humanos que foram alimentados à plataforma de direcionamento Maven do Pentágono.

Matviyuk compreendeu o padrão porque, em sua própria experiência com sistemas de armas semi-autônomos, ele constantemente precisa ponderar o grau de uso da IA à medida que a guerra de drones e as capacidades de software evoluem rapidamente no campo de batalha ucraniano. Ele observa que “o direcionamento automático nos permite capturar menos da metade dos alvos, não mais, porque eles ainda estão camuflados”. Dados do próprio Departamento de Defesa dos EUA corroboram essa limitação. O Maven consegue identificar objetos com uma precisão de aproximadamente 60% no geral, em contraste com a impressionante taxa de 84% alcançada por analistas humanos. No entanto, essa taxa de precisão cai para menos de 30% em condições adversas, como mau tempo ou baixa visibilidade, conforme dados do Pentágono publicados em um relatório da Bloomberg de 2024. O risco de “danos colaterais”, termo militar que poderia descrever o ataque à escola de Minab, é considerado excessivamente elevado. Por essa razão, a Aero Center e todas as outras empresas ucranianas de drones que conversaram com a Military Times afirmam que a decisão final de ataque é sempre deixada para um operador humano. “O impacto direto é sempre executado pelo comando do operador”, explicou Matviyuk, “para evitar que civis fiquem sob o ataque.” Em 2021, uma IA experimental de direcionamento da Força Aérea dos EUA obteve cerca de 25% de precisão em condições reais, apesar de avaliar sua própria confiança em 90%, conforme relatou o então major-general Daniel Simpson, assistente do vice-chefe de gabinete para inteligência, vigilância e reconhecimento da Força Aérea, à Defense One.

O incidente na Escola Shajareh Tayyebeh em Minab serve como um lembrete contundente dos desafios inerentes à integração de sistemas avançados de IA em operações militares de alta complexidade. Embora a inteligência artificial prometa revolucionar a capacidade de direcionamento, a necessidade de supervisão humana criteriosa, baseada em dados precisos e atualizados, permanece inquestionável para mitigar riscos catastróficos. Continue acompanhando as análises aprofundadas da OP Magazine sobre defesa, geopolítica e segurança, e siga nossas redes sociais para não perder nenhuma atualização sobre os desenvolvimentos mais críticos do cenário global.